Flink实时数据处理

来自CloudWiki

Xiaolongyang(讨论 | 贡献)2020年8月2日 (日) 11:38的版本

目录

Flink实时统计目标:

1.编程读取kafka缓存数据

2.商品实时统计:

(1)每日销售额,每日访问流量实时统计

(2)每日每家门店总销售额实时统计

(3)每日商品销量实时统计,并选出10大热销商品

(实现过程中,时间单位设置为1~2分钟)

配置开发环境:intellij & IDEA && Maven &&JDK

1.pom.xml配置,打开IDEA<我这里使用的是2018.3.6版本>

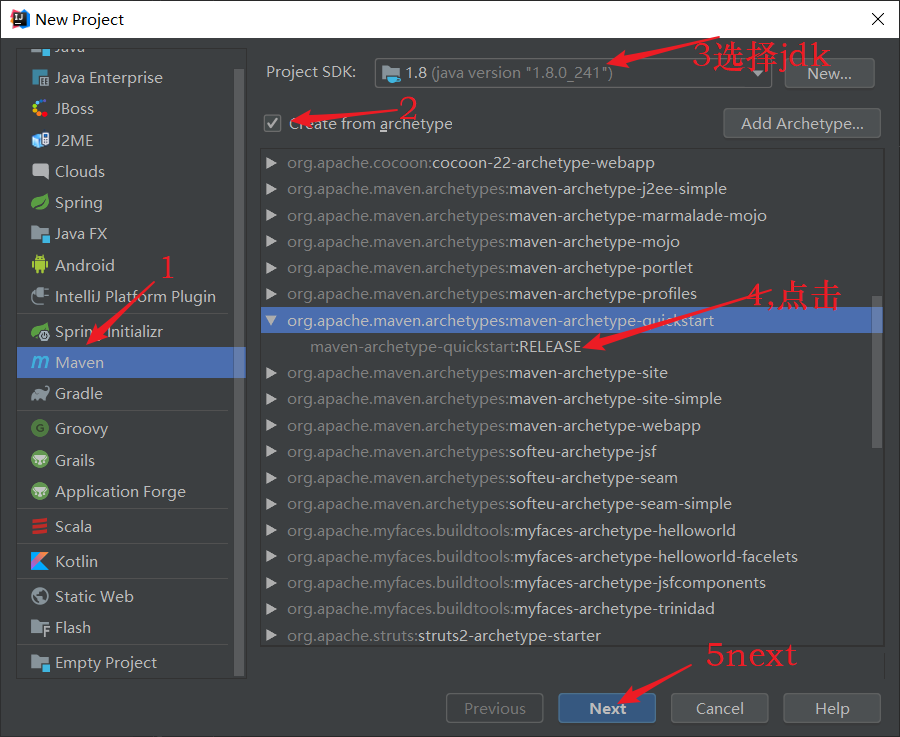

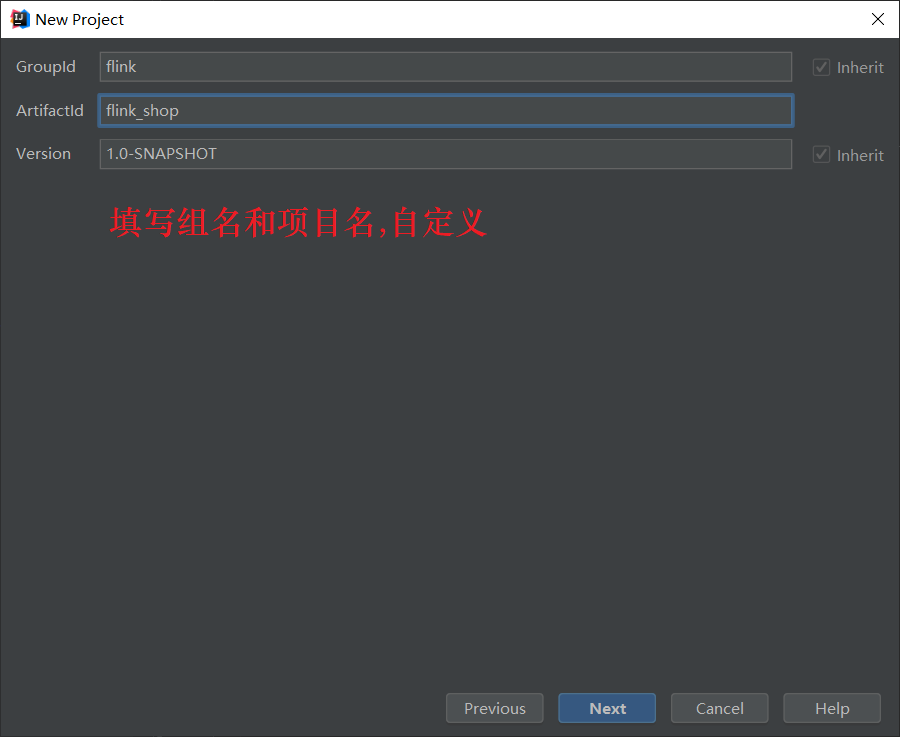

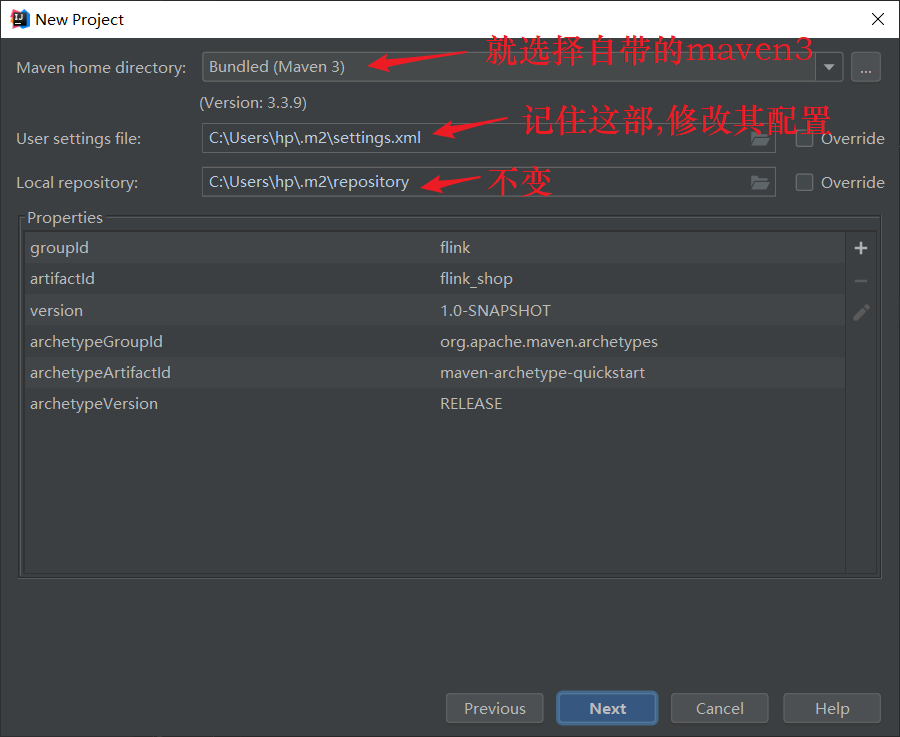

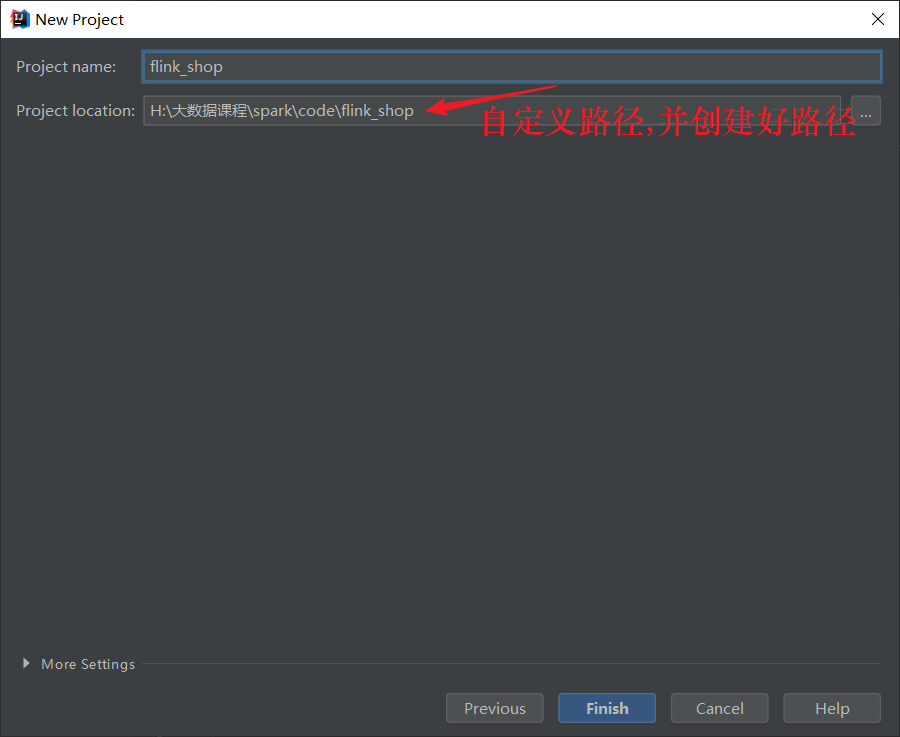

(1)首先创建一个新项目Create New Project,操作如下

(2)右下角都会出现 Maven projects need to be imported(项目需要导入依赖)<IDEA2020版本取消了导入默认依赖提示>

(3)修改pom.xml默认依赖(根据以下代码进行局部更改)

<properties>

<maven.compiler.target>1.8</maven.compiler.target>

<maven.compiler.source>1.8</maven.compiler.source>

</properties>

<build>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<version>3.6.1</version>

<configuration>

<source>1.8</source>

<target>1.8</target>

</configuration>

</plugin>

</plugins>

</build>

(4)向pom.xml中的<dependencies></dependencies>添加依赖

<!-1flink-steaming依赖:流计算-->

<dependency> <groupId>org.apache.flink</groupId> <artifactId>flink-streaming-scala_2.11</artifactId> <version>1.10.1</version> </dependency>

<!-2flink-client客户端依赖-->

<dependency> <groupId>org.apache.flink</groupId> <artifactId>flink-clients_2.11</artifactId> <version>1.10.1</version> </dependency>

<!-3flink连接kafka依赖-->

<dependency> <groupId>org.apache.flink</groupId> <artifactId>flink-connector-kafka_2.11</artifactId> <version>1.10.1</version> </dependency>

<!-4mysql依赖:将数据存入mysql中-->

<dependency> <groupId>mysql</groupId> <artifactId>mysql-connector-java</artifactId> <version>5.1.45</version> </dependency>

<!-5添加定义日志格式-->

<dependency> <groupId>org.slf4j</groupId> <artifactId>slf4j-log4j12</artifactId> <version>1.7.7</version> <scope>runtime</scope> </dependency> <dependency> <groupId>log4j</groupId> <artifactId>log4j</artifactId> <version>1.2.17</version> <scope>runtime</scope> </dependency>

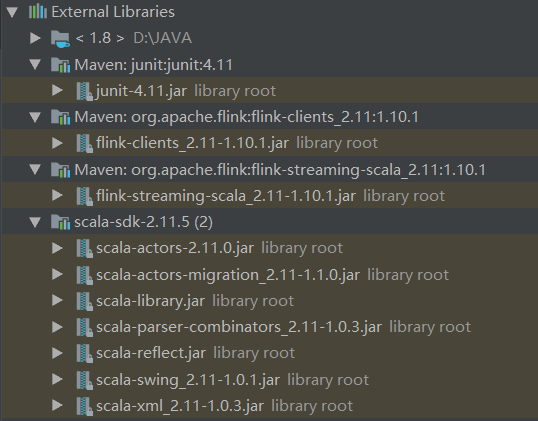

(5)添加完依赖以后就可以看到左侧External libraries里面有导入的依赖包,以及它的jar文件

2.添加scala支持

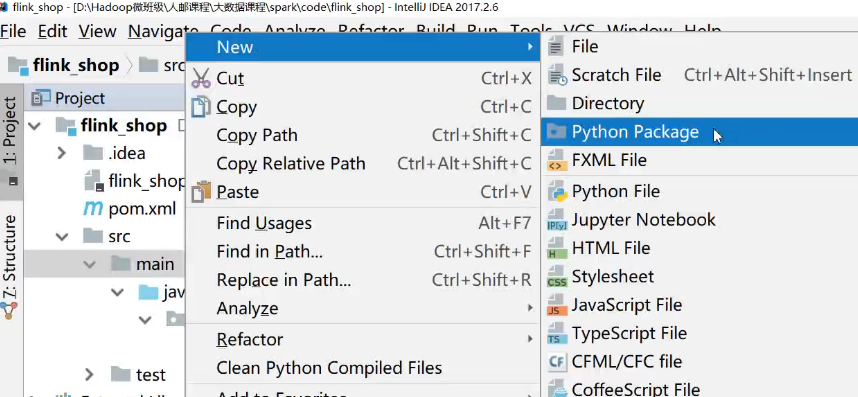

(1)在src下main中创建一个名为scala的包

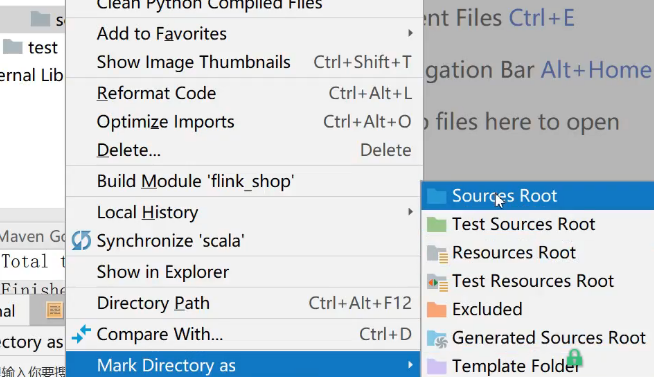

(2)选中刚刚创建的scala包,右键Mark Directory as 点击 Sources Root:将scala做成一个源码包

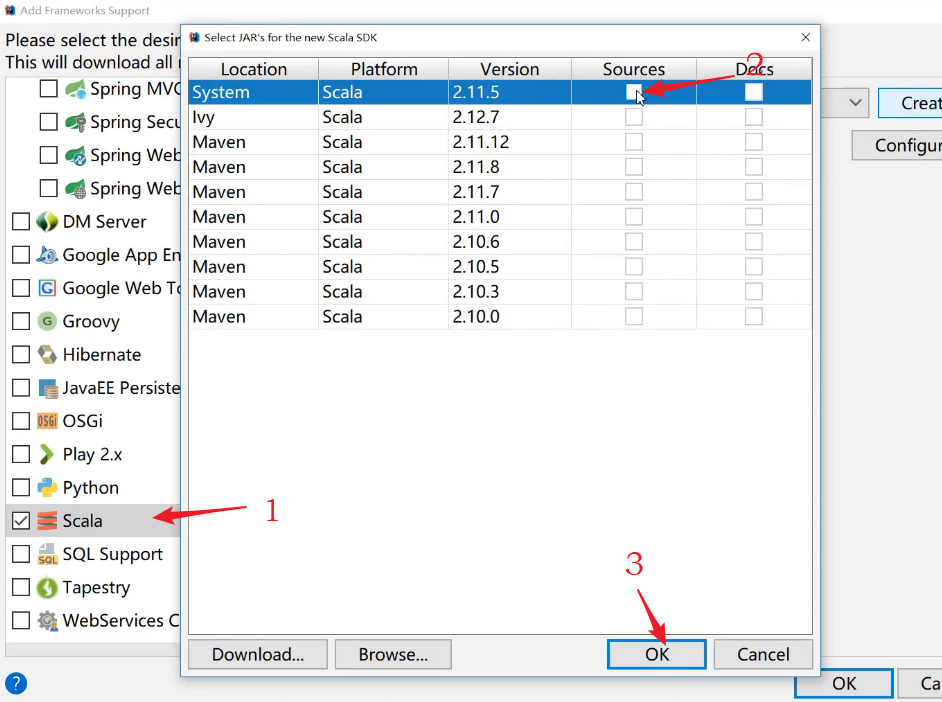

(3)在setting,plugins中安装scala(时间可能较久),然后选择项目文件添加scala支持

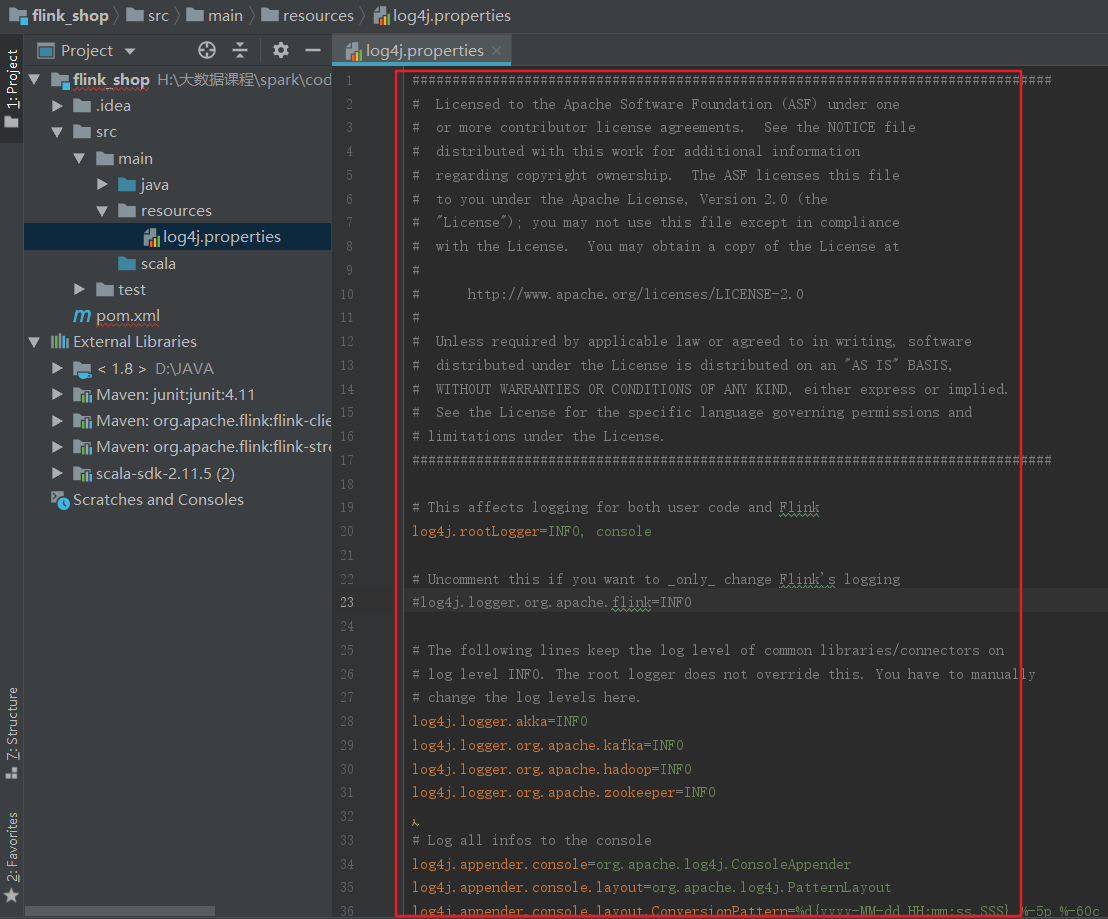

3.IDEA中log配置

(1) 在所创建项目中的main里面创建文件夹resources,增加文件log4j.properties

(2) 增加日志:log4j.properties中的日志来源于master节点

cd /usr/local/flink-1.9.2/conf/

cat log4j-console.properties

将cat到的内容全部复制到IDEA相应文件中如下所示

以上就是配置完成IDEA中的环境,数据处理将在该工程下实现